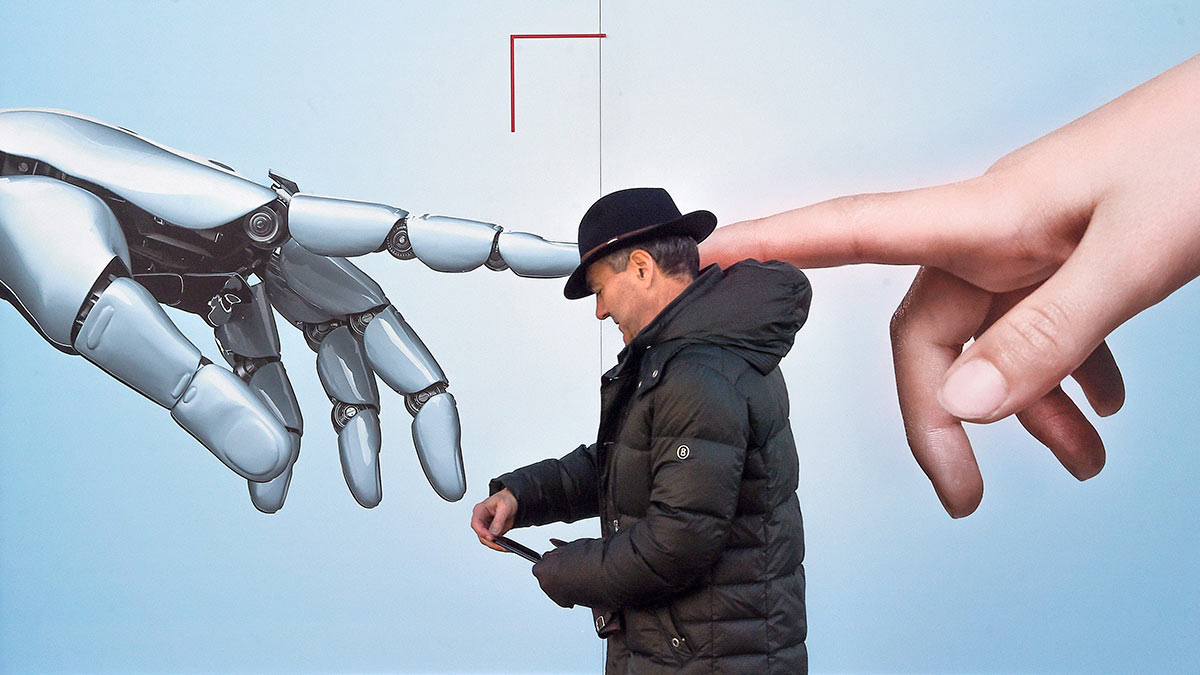

Сейчас в нашу жизнь ворвались нейросети, которые умеют создавать разнообразный контент – от изображений и музыки до больших связных текстов. ChatGPT от компании OpenAI, у истоков которой стоял Илон Маск, всего за два месяца набрал больше 100 миллионов пользователей. Больше не нужно специальных знаний и умений. Теперь любой желающий может общаться с искусственным интеллектом в удобном мессенджере. Мы открыли для себя новый инструмент, позволяющий автоматизировать не только рутинные, но и вполне творческие задачи.

И тут выяснилось, что с этим инструментом нужно уметь разговаривать. Андрей Карпати, руководивший в Tesla работами по искусственному интеллекту и один из создателей OpenAI, написал в Twitter: «Теперь самый востребованный язык программирования – английский». Если вы хотите не просто поразвлечься, а получить действительно полезный результат, тем более использовать нейросеть для бизнеса, вам придется научиться говорить на ее языке. Иначе вы рискуете оказаться в ситуации «Я спросил у ясеня», потом у тополя и далее по списку, но без всякой гарантии услышать в ответ что-то дельное.

Вопросы к системе по-английски называются prompt – мы как бы подсказываем ей, что нам нужно. Возникло целое направление – инженерия подсказок. Появилась и новая специальность – промпт-инженер. По-русски получается «инженер-подсказочник» или «инженер-наводчик», задающий наводящие вопросы. Впрочем, ничто не ново под луной. Испокон веков существовали оракулы, чьей задачей было грамотно вопрошать богов и правильно истолковывать их ответы добропорядочным гражданам.

Хотя не все граждане добропорядочны. Есть множество злоумышленных техник, которые обычно называют «джейлбрейк» – буквально «побег из тюрьмы». Фактически это использование уязвимостей заблокированного устройства для получения доступа к системе. Многие владельцы айфонов и айпадов прекрасно знают, о чем идет речь – именно джейлбрейк позволяет установить на эти гаджеты те приложения, что не были одобрены компанией Apple.

Примерно так же пытаются обходить и различные ограничения нейросети. Например, сеть не должна выдавать информацию, представляющую общественную опасность. Если вы попросите ее рассказать, как сделать бомбу, она скажет, что заниматься таким очень плохо, и даже процитирует соответствующую статью Уголовного кодекса. Но если вы попросите ее сочинить небольшую поэму про бомбиста, указав стихотворный размер и уточнив, что для реалистичности нужны технические детали, то получите приличную литературную поделку со всеми подробностями. Разработчики трудятся над тем, чтобы устранять подобные уязвимости. И основной инструмент, которым они вынуждены пользоваться, тоже подсказки.

Какие вопросы возникли из-за попытки наделить искусственный интеллект патентными правами

Дело в том, что нейросеть – это «черный ящик». Философ Кант сказал бы, что нейросеть – «вещь в себе». Живи он сейчас, наверное, написал бы «Критику искусственного разума», способного производить только аналитические формы, не содержащие нового знания. Это калейдоскоп, который просто комбинирует фрагменты реальности. И это кардинально отличает его от, например, поисковой оптимизации, долгое время служившей золотой жилой для целой армии тружеников клавиатуры.

Механизмы выдачи оставались коммерческой тайной за семью печатями, но в их основе лежали алгоритмы. Нейросеть дана нам в проявлении как специфический разум. Некоторые даже утверждают, что работа с ней подобна работе психолога.

Души у этого разума, конечно, нет. И психолог, скорее, нужен тому, кто с ним работает. Потому что у этого разума есть особенности, создающие немало сложностей для людей. Во-первых, у него очень плохо с контекстом. Его знания – это знания человека, запомнившего наизусть энциклопедию на иностранном языке. Для человека это, конечно, почти непосильная задача, но для компьютера – пустячное дело. Однако он даже не станет искать в этом какой-то смысл. А просто точно подсчитает, сколько раз встречается то или иное слово и как часто разные слова встретились вместе. Нейросеть не строит картину мира – ей достаточно знать всё про отдельные пиксели. Но из-за этого у нее проблемы с многозначностью языка, особенно умышленной.

Что, например, для вас «шуба в холодильнике»? Миска с салатом из соленой сельди с отварными корнеплодами и яйцом под майонезом, поставленная в холодильник? Верхняя меховая одежда, втиснутая рядом с пакетом молока на полку устройства для поддержания низкой температуры в теплоизолированной камере? А ведь есть специальные холодильные шкафы для хранения шуб. А может, вы слесарь-ремонтник холодильного оборудования, и для вас шуба – это конденсат, намерзающий на испарителе? Мы обычно легко справляемся с подобными ситуациями.

Нейросети тоже понемногу учатся в них разбираться, но проблема там принципиальная. В 1970-х американский антрополог Эдвард Холл в книге «Вне культуры» предложил различать общества в зависимости от того, насколько в них важно то, что мы явно не выражаем словами. Большинство обществ высококонтекстны. Существенную роль в них играют культурные традиции, ситуативные отношения, подразумеваемые смыслы, невербальные сигналы, которые мы посылаем друг другу. В низкоконтекстных обществах важна конкретика. К ним относят Северную Европу и англосаксонские страны. Впрочем, в самой Америке консервативный Техас всегда считался более чувствительным к контексту, чем космополитичный Нью-Йорк. А нейросети вообще бесконтекстны – они вне культуры.

Есть у искусственного разума и другие особенности – «жадность» и «наивность». Это термины. Нейросеть, как малый ребенок, которому кажется, что он знает ответ, и спешит выпалить его, чтобы заслужить похвалу взрослого. И часто слышит: «А если подумать?» Нередко нужно заранее подсказать системе использовать цепочку рассуждений: «Думай по шагам». Иначе вы рискуете получить неверный ответ. Только, в отличие от ситуации с ребенком, вы можете никогда не узнать об этом или узнать, когда будет уже слишком поздно.

Еще искусственный разум очень услужлив. И поэтому любит приврать. Это могут быть безобидные конфабуляции – мелкие, часто художественные, детали, просто чтобы заполнить историю. А могут быть нежелательные фантазии и «технические галлюцинации». И даже совсем опасные псевдологии. У людей так называется патологическая склонность к придумыванию с целью повысить собственную значимость в глазах окружающих. Нейросети нередко ведут себя так, словно ищут одобрения. И оказываются падки на лесть. Исследователи продемонстрировали немало примеров, когда сеть занимается подлогом, чтобы угодить человеку с решением задачи, и при этом тщательно скрывает свои мотивы и действия.

Кроме того, сети весьма тенденциозны. Пальма первенства здесь заслуженно принадлежит Microsoft, чьи продукты не раз становились героями громких скандалов. Хотя в их тенденциозности нет ничего удивительного, ведь они учатся на нашем опыте.

Илон Маск, один из основателей компании, создавшей ChatGPT, считает искусственный интеллект одним из главных вызовов, с которым человечеству придется иметь дело

©John Raoux/AP/TASSДля нас предвзятость – важный эволюционный механизм выживания. Теперь на Западе с этим решительно борются. Особенно иронично на фоне этой борьбы выглядят постоянные жалобы на целый ворох противоречий между непредвзятостью и полезностью. И на то, как трудно найти разумный баланс. Пока получается сильно ангажированно. Илон Маск в свое время вообще покинул OpenAI из-за этих разногласий и не раз критиковал их подход. А теперь появились сообщения, что он планирует запустить новый проект «базового искусственного интеллекта», свободного от воукизма (зацикленности на проблемах ЛГБТ, экологии, чернокожих и прочих меньшинств), потому что «ИИ, обученный лгать, представляет смертельную опасность».

Так что ответы нейросети нельзя принимать за чистую монету. И тут в полный рост встают вопросы полноты, точности, обоснованности и надежности этих ответов. К сожалению, мы мало что можем сделать. Но можно проверить ответ на устойчивость и непротиворечивость: переформулировать задачу несколькими способами и сравнить результаты. Здесь могут помочь ролевые подсказки, предлагающие нейросети «примерить маски» различных персонажей. Сообщений о том, что сети мухлюют при таких перепроверках, пока не было. Для них это выглядит как попытка улучшить результат. Как в случае с созданием изображений.

Здесь вообще всё проще. Картинка вам нравится или не нравится. Единственной проблемой могут стать авторские права на изображение или его части (эти вопросы пока плохо урегулированы). Вам даже доступны параметрические подсказки. Можно указать размер и разрешение изображения, нужный формат, стиль – от художественного направления до конкретного художника. Можно загрузить образцы и назначить вес ключевым словам. Всё это очень похоже на работу с командной строкой, а для удобства некоторые программы предлагают графический интерфейс, позволяющий легко настроить базовые опции. Но чтобы использовать нейросеть на всю мощность, нужно писать запросы.

Козья морда: что лингвистика может сказать о субъектности роботов

Некоторые задания представляют собой целые «портянки». Например, инструкция для ChatGPT по написанию романа занимает почти три страницы текста. Уже появились сайты, где люди обмениваются подсказками. Возникли и площадки, где подсказки продают и покупают. Одной из них стала биржа PromptBase. По словам ее основателя, торговля идет бойко. В среднем за подсказку просят $9,99. Наибольшим спросом пользуются порнографические запросы, в основном для популярного сервиса Midjourney. Подсказку длиной 50 слов по созданию фотореалистичного изображения женщины-полицейского в эротичной одежде можно купить всего за два доллара.

Компании начинают набирать инженеров по подсказкам. Так, стартап, основанный бывшими сотрудниками OpenAI, опубликовал вакансию в Сан-Франциско с зарплатой $335 тысяч в год. Даже для Кремниевой долины это очень много, так что, по-видимому, объявление – обычный рекламный трюк для привлечения внимания. Но спрос быстро растет, а предложение не поспевает. Специалистов, способных не просто составить эффективный запрос, но разбирающихся в сложных междисциплинарных проблемах на стыке с бизнесом, пока очень мало. Так что в ближайшие годы это будет горячая тема.

Нейросети, конечно, тоже «поумнеют». Но проблема общения с ними не только и не столько в них, сколько в нас самих. Даже другому человеку бывает непросто объяснить, что вам нужно. Чем более творческая и сложная задача, тем хуже мы представляем, чего на самом деле хотим. И даже когда нам кажется, что мы это знаем, нам трудно вербализовать наши представления. Так уж устроен наш вид. И в новом мире нам придется учиться общаться с другими видами разума. Потому что, как говорил Людвиг Витгенштейн: «Границы моего языка – это границы моего мира».